AI(人工知能)によるサイバーセキュリティへの影響を受け入れるべき時代の到来

サイバー犯罪者が、現在よりはるかに高度な標的型攻撃を考え出し、実行するために、AIを悪用し始めることは時間の問題です。サイバー犯罪者は、AIモデルを構築するためのデータを収集するボットを所有しており、AIモデルを構築するための技術者を採用する金銭的余裕もあります。また、多くの国家がサイバースパイ活動を行うためにAIを悪用していることは、ほぼ確実です。

リアルタイム情報サービスプロバイダNeustarからの新しいレポートによると、同社がInternational Cyber Benchmarks Indexを作成するために調査しているサイバーセキュリティプロフェッショナルの82%はハッカーがAIを悪用した攻撃を実行する可能性を懸念しています。直近のBlack Hat USAカンファレンスでは、IBMの調査担当者が、複数のAIモデルを組み合わせて非常に検出しにくいマルウェアを作成するツールDeepLockerを開発して、このような攻撃の実行可能性をデモしました。

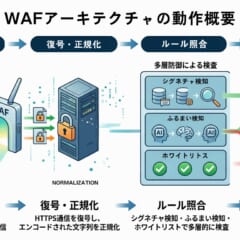

企業がAIモデルを悪用した攻撃を防止するには、もちろん、自社のAIモデルにアクセスできる必要があります。問題は、企業がこのようなAIモデルを構築するには、多くの時間と労力が必要なだけでなく、サイバー攻撃を検出するAIモデルを構築するためのML(機械学習)およびディープラーニングアルゴリズムを教えるための大量のデータにアクセスできる必要もあるということです。また、サイバー攻撃の高度化に合わせて、このようなAIモデルを常に更新する必要もあります。実際は、企業はこのようなAIモデルの構築に投資するためのリソースを所有するベンダが提供するサイバーセキュリティサービスをますます使用する必要があります。

このようなAIモデルによるサイバー攻撃の検出が向上すると、当然、サイバーセキュリティプロフェッショナルの役割も変化します。AIによって、近いうちにサイバーセキュリティプロフェッショナルが不要になるわけではありません。むしろ、AIで強化されたサイバーセキュリティプロフェッショナルはAIモデルで強化されたサイバー犯罪者と戦います。大量のデータをわずか数秒で損失する可能性があるため、このような戦いは規模とリスクの両方の点でますます激化します。このような変化の一環として、ほとんどの低レベルのサイバーセキュリティタスクは自動化されます。つまり、サイバーセキュリティ分野への参入は現在より困難になるということです。

少なくとも理論上は、サイバーセキュリティの状況が全般的に向上するはずです。最近のほとんどの侵害の原因の一つは人的エラーです。AIによって、アプリケーションを実稼働環境に導入する前に、現在よりはるかに多くの脆弱性を検出および修正できるようになるはずです。つまり、IT環境内のエンドポイントが急増するとともに、エンドポイントごとのセキュリティレベルも現在よりはるかに高くなるはずです。

サイバーセキュリティには、もちろん、魔法のような特効薬的なAIソリューションはありません。しかし、機械の役割は現在よりはるかに大きくなります。サイバーセキュリティチームは機械に依存しすぎないようにすることが賢明です。しかし、全般的には、今後の数か月間および数年間のAIによる強化によって、サイバーセキュリティにいら立ちを感じることが、少なくとも現在よりはるかに少なくなることは確実です。

*本内容はBarracuda Blog から、2018年11月02日 Time to Come to Terms with the Impact AI Will Have on Cybersecurity を翻訳したものです。

この記事へのコメントはありません。